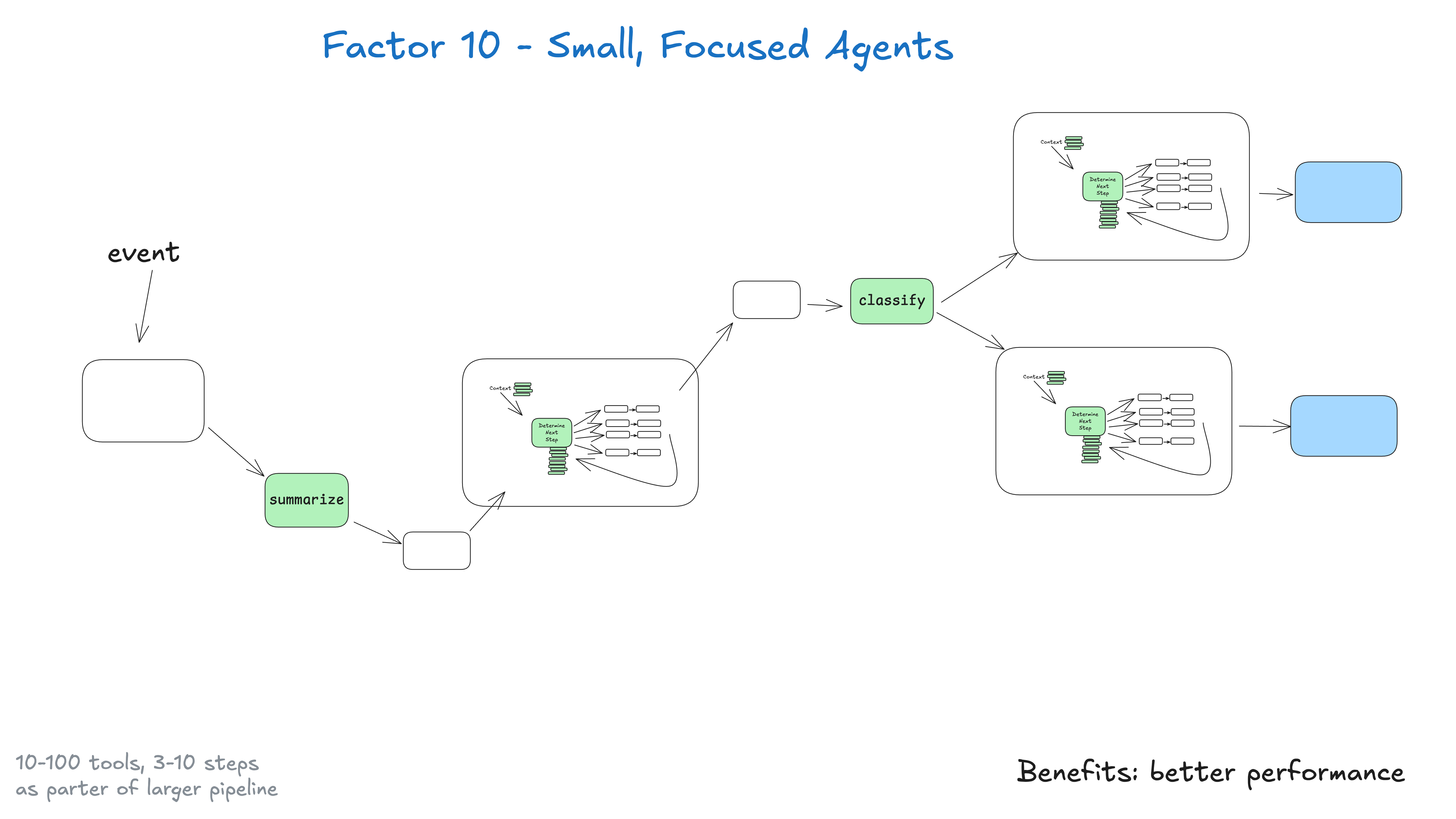

架构10. 小型、专注的智能体 (Agents)

与其构建试图包办一切的大型单体智能体,不如构建小巧、专注、只做好一件事的智能体。智能体只是一个更大的、基本确定的系统中的构建模块之一。

这里的关键见解在于LLM(大语言模型)的局限性:任务越庞大、越复杂,所需的步骤就越多,这意味着需要更长的上下文窗口。随着上下文的增长,LLM更容易迷失方向或失去焦点。通过让智能体专注于特定领域,最多处理 3-10 步(也许最多 20 步),我们可以将上下文窗口保持在可控范围内,从而保持较高的LLM性能。

随着上下文的增长,LLM 更容易迷失方向或失去焦点

小型、专注的智能体的好处:

- 可控的上下文:更小的上下文窗口意味着更好的 LLM 性能

- 清晰的职责:每个智能体都有明确的范围和目的

- 更好的可靠性:在复杂工作流中迷失的可能性更小

- 更容易测试:测试和验证特定功能更简单

- 改进的调试:出现问题时可更轻松地识别和修复

如果 LLM 变得更聪明了呢?

如果 LLM 变得足够智能,能够处理 100 步以上的工作流,我们是否还需要这样做?

tl;dr (太长不看版):是的。随着智能体和 LLM 的改进,它们可能会自然地扩展以处理更长的上下文窗口。这意味着能够处理更大有向无环图 (DAG) 中的更多部分。这种小型、专注的方法确保你今天就能获得结果,同时为你在 LLM 上下文窗口变得更可靠时逐步扩展智能体范围做好准备。(如果你以前重构过大型确定性代码库,现在可能会点头表示赞同)。

有意识地控制智能体的大小/范围,并且只以能够保持质量的方式增长,是这里的关键。正如[构建 NotebookLM 的团队所说]:

我感觉到,对我来说,构建 AI 时最神奇的瞬间,往往发生在我真的、真的、真的刚好处于模型能力边界的时候。

无论这个边界在哪里,如果你能找到这个边界并持续稳定地把握好它,你就能构建出神奇的体验。这里有很多“护城河”可以构建,但像往常一样,这需要一些工程上的严谨性。